Depuis le 3 février 2026, quelque chose d'inhabituel se passe dans les dashboards SEO. Des hausses massives de visibilité pour YouTube, TikTok et Dailymotion sur des requêtes transactionnelles où ces plateformes n'ont objectivement rien à faire. Le Semrush Sensor qui frôle les 9,5/10, ce que la communauté appelle un “Googlequake”. Des équipes qui réallouent des budgets vers la vidéo en urgence. Des alertes clients à n'en plus finir.

Sauf que personne ne bougeait vraiment dans les SERPs. Pas pour les humains, en tout cas.

Google avait simplement décidé de mentir aux robots en présentant ce qu'on nomme aujourd'hui, des shadow SERPs.

- Depuis février 2026, Google sert des SERPs volontairement falsifiées aux bots de tracking (Semrush, Ahrefs, Monitorank, Semscraper...)

- Ces fausses SERPs sont saturées de YouTube, TikTok et Dailymotion, jusque sur des requêtes purement transactionnelles

- Le système s'appelle SearchGuard, le BotGuard de Google Search. Il ne bloque plus, il corrompt

- Monitorank a détecté le problème dès le 3 février 2026 et a déployé un correctif. D'autres outils n'ont pas réagi assez vite

- La Google Search Console reste la seule source first-party non biaisée. Pensez à tout extraire via BigQuery.

Shadow SERP : ce que Google fait vraiment (et ce n'est pas un bug)

Les outils SEO de tracking ont toujours scrapé les SERPs. Semrush, Ahrefs et leurs concurrents envoient des millions de requêtes automatisées à Google chaque jour, depuis des proxies rotatifs, avec des user-agents variés, pour vous remonter vos positions. C'est leur modèle depuis leur création.

Google le sait depuis toujours. Et jusqu'en 2025, la réponse était simple. Bloquer ou ralentir les bots détectés.

En 2026, Google a changé de stratégie. Il ne bloque plus. Il ment.

Dès qu'un comportement automatisé est identifié, volume de requêtes anormal, absence d'exécution JavaScript, user-agent suspect, pattern de scraping reconnu, le moteur sert une SERP alternative. Une shadow SERP. Remplie de résultats vidéo, de contenus sociaux, de formats que l'utilisateur humain sur son ordinateur ou son téléphone ne verra jamais.

C'est infiniment plus efficace qu'un blacklisting. Le bot ne sait pas qu'il est piégé. Il renvoie ses données comme si de rien n'était. Et vous, vous les lisez comme si elles étaient vraies.

Le système derrière ça s'appelle SearchGuard. C'est la déclinaison de BotGuard spécifiquement pour Google Search, déployée à grande échelle en janvier 2025. Il analyse en temps réel les mouvements de souris, les patterns de requêtes, la présence ou non d'exécution JavaScript, et il tourne dans une machine virtuelle bytecode à 512 registres conçue pour résister au reverse engineering. Google l'a révélé lui-même dans son procès contre SerpApi, déposé en décembre 2025 en Californie.

Google ne punit plus les bots. Il les nourrit avec de la donnée corrompue pour que leur référence soit fausse.

La logique est limpide. Rendre le reverse-engineering de son algorithme insoutenable. Empoisonner les données concurrentes. Et au passage, attaquer en justice quiconque contourne le système à l'échelle commerciale.

À quoi ressemble concrètement une shadow SERP ?

Voilà ce que vos outils ont ingéré entre février et fin mars 2026 sur une partie de leurs requêtes.

Sur des mots-clés transactionnels, “acheter chaussures running”, “devis isolation combles”, “avocat divorce Paris”, YouTube et Dailymotion apparaissent massivement en pages 2 et 3. Pas des vidéos de qualité, pas des tutoriels qui auraient une légitimité éditoriale. Des résultats vidéo génériques, qui n'ont aucun rapport avec l'intention de recherche et qu'aucun utilisateur ne verra jamais.

TikTok et Instagram s'invitent aussi, selon les requêtes et les marchés.

Les résultats organiques classiques, sites web, e-commerces, blogs, sont repoussés, parfois dupliqués, parfois absents.

Un outil qui ne détecte pas qu'il reçoit cette soupe vous la présente comme la réalité. C'est exactement ce qui s'est passé pour plusieurs outils majeurs en mars 2026, pendant que le Semrush Sensor affichait un score de volatilité historique. Un artefact de mesure habillé en séisme algorithmique.

L'impact concret sur vos données et vos décisions SEO

C'est là que ça fait vraiment mal.

Les positions organiques biaisées

Semrush ou Ahrefs vous remontent des “hausses” spectaculaires pour YouTube et TikTok. Votre client, ou votre équipe, en conclut que la vidéo domine désormais son secteur. Des budgets bougent. Des stratégies s'ajustent. Sur la base de données qui ne reflètent pas ce qu'un seul humain a vu.

Le Semrush Sensor en surchauffe

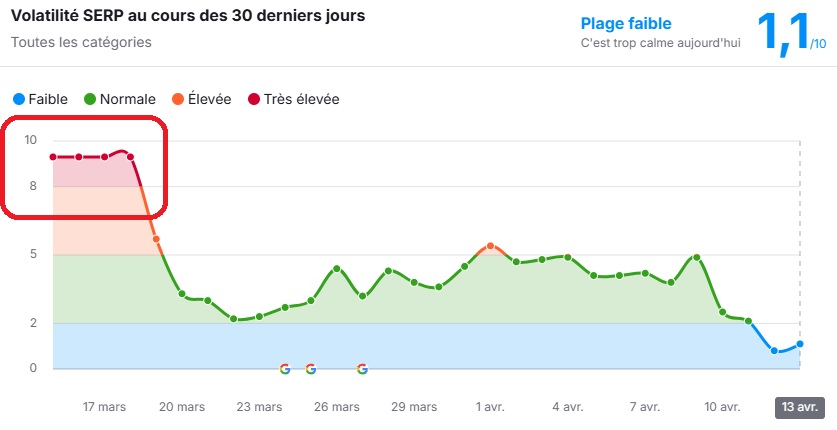

Le 1er avril 2026, le Semrush Sensor frôlait les 9,5/10 sur certaines niches US.

La communauté SEO s'est alors agitée et des "experts" ont annoncé un Googlequake majeur... C'était en grande partie un artefact de mesure lié aux shadow SERPs. Ce que Garletti a bien documenté dans son analyse publiée début avril.

Avant cette date, le Semrush Sensor (US) a oscillé entre 9.1 et 9.5/10 durant tout début mars 2026.

Le “share of voice” rendu illisible.

Si votre outil de suivi de positionnement ingère une SERP où YouTube occupe les positions 4 à 8 sur votre requête principale, votre part de voix calculée s'effondre artificiellement. Votre concurrent “gagne” des parts qu'il n'a pas gagnées. Et vous optimisez en réaction à quelque chose qui n'existe pas.

Le scénario classique. Un client appelle parce que son outil lui signale qu'il a perdu 15 positions du jour au lendemain. Vous regardez la Search Console. Rien ne bouge. Vous perdez 45 minutes à expliquer que les données tierces sont compromises.

Monitorank a vu venir le truc. Pas tous les autres.

Fabien Barry, fondateur de Monitorank, a posté sur X dès le matin du 3 février 2026 :

“Page 2 et 3 retourne de nombreux résultats Youtube et Dailymotion. Peut être un changement pour Google. Quand il détecte un bot au lieu de le blacklister, il fournit de la data non fiable.”

Monitorank a déployé un correctif dans la foulée. Semscraper, qui partage la même infrastructure, aussi.

Fin mars 2026, Google est revenu à la charge avec une nouvelle vague de shadow SERPs. Monitorank a tenu. D'autres outils majeurs ont remonté pendant plusieurs semaines des données que leurs clients ont prises pour argent comptant.

Ce n'est pas une critique générique des outils. C'est un fait de calendrier. La réactivité a été très inégale, et les utilisateurs des outils les moins réactifs ont pris des décisions sur des données corrompues pendant des semaines.

Méthode pour réagir face aux collectes de Shadow SERP

1. Recentrez sur la Search Console

La Google Search Console est une source first-party. Google ne lui ment pas à elle-même. Les impressions, les clics, les positions moyennes qu'elle remonte sont les données réelles du moteur sur votre site. Pendant toute période de shadow SERP active, c'est votre seul étalon de confiance.

Si votre outil tiers dit que vous avez perdu 12 places et que la GSC ne montre rien, faites confiance à la GSC.

2. Séparez les types de résultats dans votre reporting

Dans vos exports Semrush ou Ahrefs, apprenez à distinguer les features vidéo des résultats organiques classiques. Construisez deux KPI distincts. Un KPI “web organique pur” (domaines classiques, pas de vidéo, pas de social) et un KPI “vidéo + réseaux sociaux”. Ne les agrégez jamais dans un seul score de visibilité.

Si votre outil ne permet pas ce filtrage proprement, vous avez un problème d'outil.

3. Comparez manuellement quand quelque chose cloche

Avant de valider une alerte de volatilité ou une variation de position, regardez la SERP à la main. Desktop, mobile, sans VPN, depuis une IP résidentielle. Pas depuis votre datacenter. Ce que vous voyez à la main, c'est ce qu'un utilisateur voit. C'est la réalité qui compte.

4. Auditez votre stack de tracking

Tous les outils n'ont pas répondu aussi vite que Monitorank. Si vous utilisez un outil qui n'a pas documenté publiquement sa réponse à la shadow SERP de février-mars 2026, posez la question à leur support. Demandez explicitement comment ils ont géré les shadow SERPs de février et mars 2026 et quand ils ont déployé un correctif.

La réponse vous dira beaucoup sur la maturité technique de l'équipe derrière l'outil. En cas de doute, un audit SEO complet de vos sources de données est le point de départ le plus sûr.

Ce que ça dit sur la direction que prend Google

Ce n'est pas le premier coup dans cette guerre. En 2025, Google a supprimé le paramètre &num=100, multipliant par dix le nombre de requêtes nécessaires pour scraper une SERP complète. Il a rendu l'exécution JavaScript obligatoire pour accéder aux résultats complets. Il a attaqué SerpApi en justice via le DMCA Section 1201.

La trajectoire est claire. Google veut reprendre le contrôle de l'accès à ses données de SERP. Les outils tiers coûtent cher en ressources serveur et permettent à ses concurrents, OpenAI en tête via SerpApi, de reverse-engineer son algorithme à moindre coût. Empoisonner les données qu'il sert aux bots, c'est la réponse la plus élégante. Pas de blocage visible, pas de procès immédiat, juste une dégradation silencieuse de la confiance dans les données tierces.

Et pendant ce temps, Googlebot crawle librement l'intégralité du web pour entraîner Gemini.

Il y a une ironie assez brutale dans cette situation. Mais c'est une autre conversation.

Ce que vous devez retenir, pratiquement. Vos données de positionnement tiers ne sont plus une vérité absolue. Elles n'ont jamais été parfaites, mais elles étaient au moins une approximation honnête de la réalité. Ce n'est plus garanti.

La Search Console, les logs serveur, et vos propres vérifications manuelles reprennent de la valeur. Pas parce que les outils sont mauvais. Parce que le terrain a changé sous leurs pieds.

Si vous voulez regarder ensemble ce que vos données de suivi racontent vraiment, c'est exactement ce type d'audit que nous faisons.

À lire aussi

Le SEO est-il mort en 2026 ?

Le SEO est-il mort en 2026 ?Le SEO est-il vraiment mort en 2026 ? Bilan chiffré, données de marché et perspectives : spoiler, il s...

Oops ! UnMarker.it vient de tuer les solutions officielles de watermarks

Oops ! UnMarker.it vient de tuer les solutions officielles de watermarksLes watermarks invisibles d'images IA se font effacer en quelques minutes. Google SynthID passe de 100% à 21%...

Quels métiers du web l'IA a déjà remplacé en 2026 ?

Quels métiers du web l'IA a déjà remplacé en 2026 ?Étude complète et SOURCÉE des statistiques sur la montée de l'usage des IA dans les métiers du web. Assis...

Enshittification Google et SEO : 3 techniques d'exploitation sur-mesure

Enshittification Google et SEO : 3 techniques d'exploitation sur-mesureL'enshittification de Google dégrade la recherche mais ouvre des failles SEO massives. Découvrez notre top 3...

Nouvelle loi : interdiction du démarchage téléphonique en France

Nouvelle loi : interdiction du démarchage téléphonique en FranceLa loi anti-démarchage téléphonique 2026 supprime Bloctel et impose l'opt-in obligatoire. Ce que ça change...

Le title en SEO : pourquoi il reste vital en 2025

Le title en SEO : pourquoi il reste vital en 2025Découvrez pourquoi la balise title reste un signal SEO majeur en 2025. Google réécrit 76% des titles : appr...

Le SEO en 2026 avec les évolutions de Google Search

Le SEO en 2026 avec les évolutions de Google SearchDécouvrez comment le SEO évolue en 2026 face aux bouleversements de Google Search, entre IA omniprésente, d...