Sommaire

L'interface Google Search Console impose une limite quotidienne de lignes. Pour un site avec des milliers de pages ou de requêtes actives, cette limite tronque les résultats sans le signaler. Tu travailles sur des chiffres incomplets sans le savoir. La seule méthode pour extraire l'intégralité des données de performance Search Console sans plafond est l'exportation groupée vers BigQuery. Cet export quotidien automatique couvre les clics, impressions, CTR et positions moyennes sur toutes les dimensions disponibles.

La limite de lignes Search Console, un problème silencieux pour les gros sites

Pour tout site dépassant quelques milliers de pages ou de requêtes actives, l'interface Search Console retourne une vue partielle de la réalité.

Combien de requêtes ton site génère-t-il chaque jour ? Si la réponse dépasse quelques milliers, tu n'as probablement jamais vu l'intégralité de ta donnée dans l'interface native.

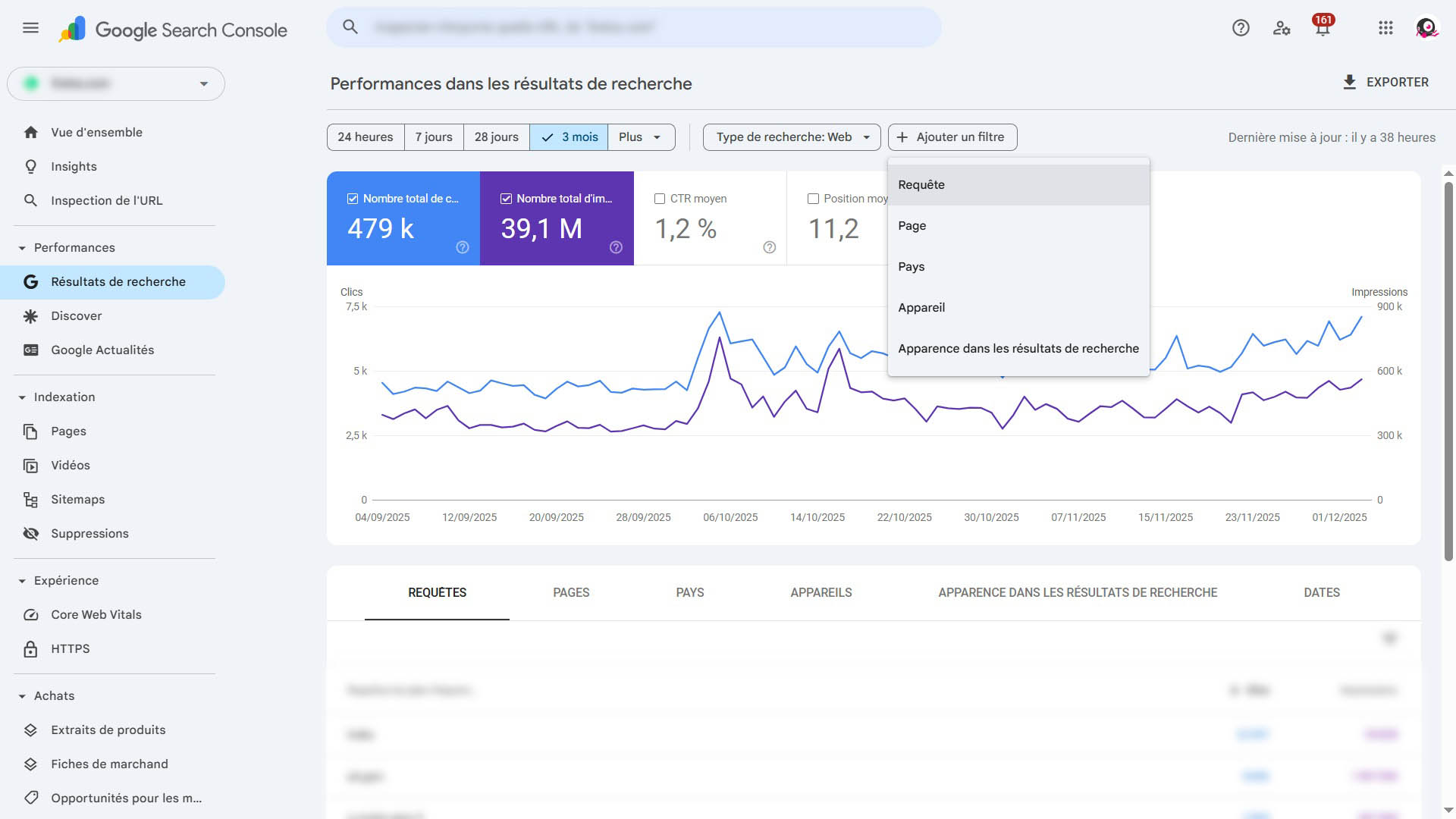

Google Search Console applique une limite au nombre de lignes retournées par l'interface et par l'API standard. Cette limite est documentée à 25 000 lignes par requête API et ne dépasse pas 1 000 lignes dans l'interface visuelle. Un site e-commerce avec 50 000 URLs actives atteint ce plafond sans le savoir. Les données manquantes ne sont pas signalées. Elles disparaissent simplement.

L'export groupé vers BigQuery supprime ce plafond. Toutes les lignes sont exportées chaque nuit, sans exception, sauf les requêtes anonymisées que Google masque pour protéger la vie privée des utilisateurs. Ce n'est pas BigQuery qui anonymise. C'est Search Console elle-même, quelle que soit la méthode d'extraction utilisée.

| Critère | Interface Search Console | Export BigQuery |

|---|---|---|

| Limite de lignes | 1 000 (interface) / 25 000 (API) | Aucune |

| Historique disponible | 16 mois glissants | Depuis la date d'activation |

| Fréquence de mise à jour | Temps réel (J-2 à J-3) | Export quotidien automatique |

| Requêtes anonymisées | Masquées | Masquées (même règle) |

| Coût | Gratuit | Gratuit sous 1 To/mois de requêtes |

| Croisement avec d'autres sources | Impossible | JOIN SQL natif |

Avant d'aller plus loin dans la configuration, il faut comprendre ce que BigQuery expose exactement. La structure des tables conditionne directement l'écriture de tes requêtes SQL.

Les trois tables BigQuery exposées par l'export Search Console

Un insight que peu de guides mentionnent. La table searchdata_url_impression stocke la position sous forme de somme, pas de moyenne. Comprendre ce détail change la façon dont tu écris chaque requête d'analyse de positionnement.

Google Search Console expose trois tables dans ton dataset BigQuery après l'activation de l'export groupé.

1. La table "searchdata_site_impression"

La table searchdata_site_impression agrège les données au niveau de la propriété entière. Elle ne descend pas à l'URL ni à la requête individuelle. Elle est utile pour suivre les tendances globales d'un site sur la durée, ou pour comparer des périodes sans avoir besoin de granularité fine.

1. La table "searchdata_url_impression"

La table searchdata_url_impression est la table centrale pour toute analyse Search Console avancée. Elle détaille chaque combinaison d'URL, de requête, de pays, d'appareil, de type de recherche et de date. C'est depuis cette table que tu construis tes analyses de positions, de cannibalisation, de CTR et de performance par segment.

1. La table "ExportLog"

La table ExportLog enregistre l'historique des exports réalisés. Elle sert à vérifier que les exports quotidiens s'exécutent sans interruption. Si un export échoue, la ligne correspondante apparaît avec un statut d'erreur.

Le passage technique

Le point qui piège la plupart des analystes. La colonne sum_position n'est pas une position moyenne. C'est une somme cumulée des positions enregistrées pour chaque impression. Pour obtenir la position moyenne réelle, tu divises sum_position par le nombre d'impressions, puis tu ajoutes 1 parce que Google indexe les positions à partir de zéro dans cette table. Une requête qui ignore ce calcul retourne des chiffres faux.

La table URL est ta source principale. La table site sert au reporting agrégé. ExportLog est ton garde-fou opérationnel.

Maintenant que la structure est claire, voici comment activer l'export en quatre étapes.

Activer l'export BigQuery Search Console, les 4 étapes de configuration

Combien de temps faut-il pour que les premières données apparaissent dans BigQuery après la configuration ? La réponse est moins évidente qu'il n'y paraît.

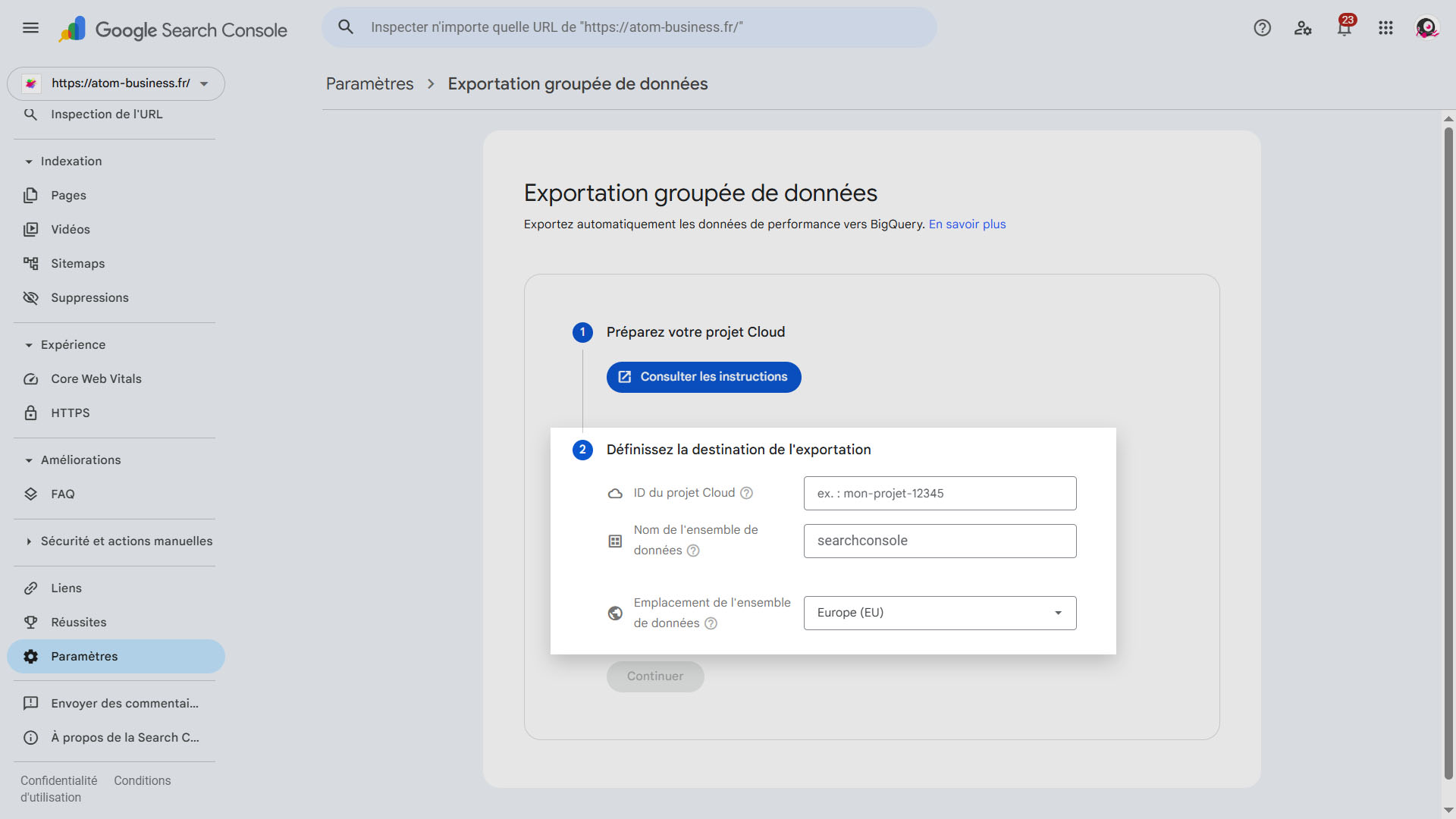

La configuration implique trois acteurs distincts. Google Cloud Console fournit l'infrastructure. L'API BigQuery gère les droits d'accès. Et Google Search Console déclenche l'export. Ces trois couches doivent être cohérentes, sinon la validation échoue sans message d'erreur explicite.

Étape 1 : Préparer le projet Google Cloud

Connecte-toi à Google Cloud Console et crée un nouveau projet ou sélectionne un projet existant. Active l'API BigQuery depuis la bibliothèque d'APIs. Note l'identifiant du projet, il sera requis à l'étape suivante. Choisis une région pour ton dataset. Cette région détermine l'emplacement physique des données et conditionne les coûts si tu croises avec d'autres sources.

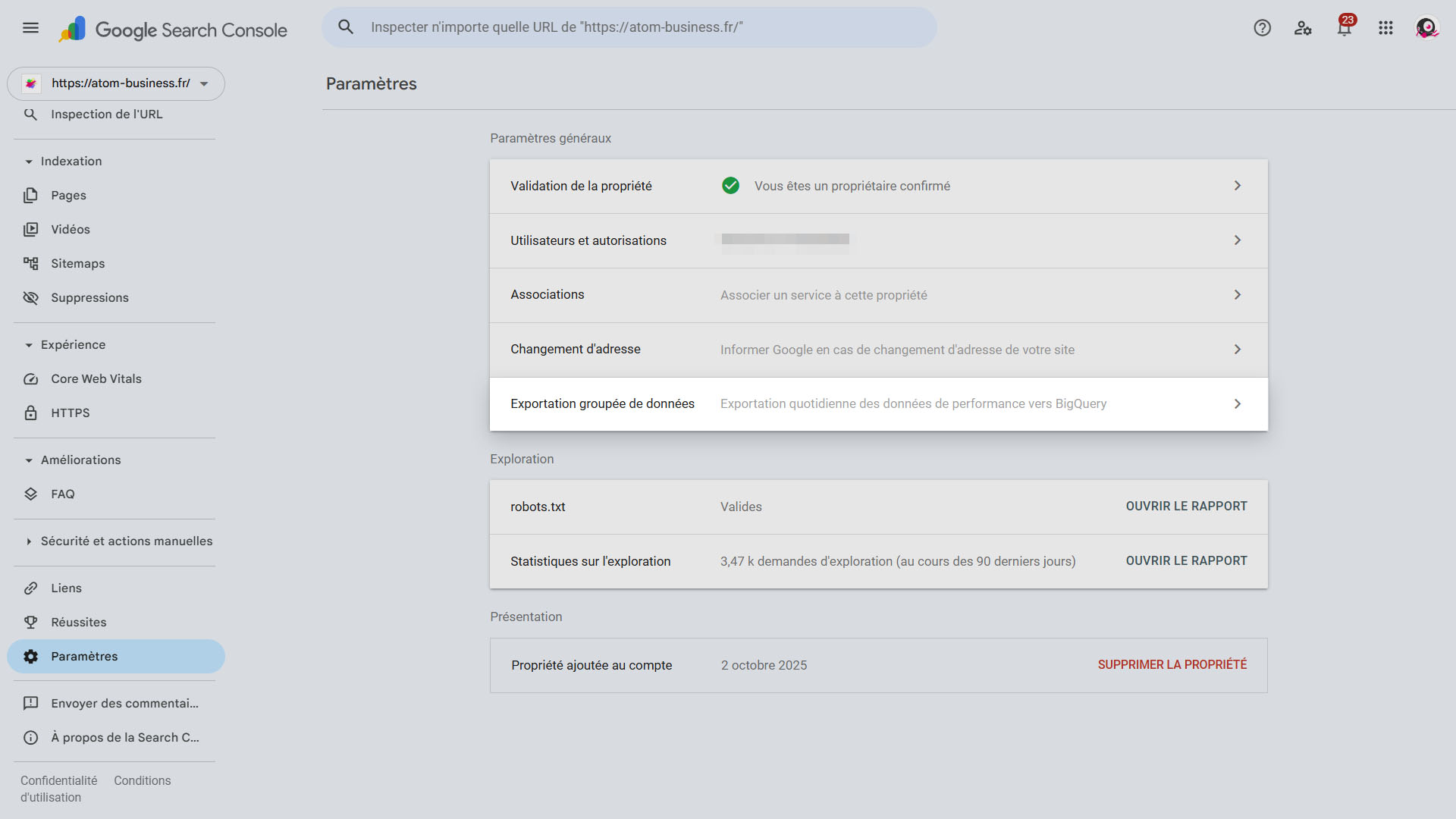

Rendez-vous dans votre Google Search Console (GSC). Choisissez votre projet puis cliquez sur Paramètres à gauche

Étape 2 : Accorder les droits au compte de service Search Console

Google Search Console utilise un compte de service dédié pour pousser les données dans BigQuery. Ce compte doit disposer du rôle BigQuery Data Editor sur ton projet. Dans Google Cloud Console, ouvre IAM et administration, puis accorde ce rôle au compte de service Search Console. Son identifiant exact est disponible dans la documentation officielle Google.

Saisissez vos informations pour définir l'export que vous souhaitez

(si besoin une documentation officielle est accessible juste au dessus).

Étape 3 : Configurer l'export depuis Search Console

Dans Google Search Console, ouvre les Paramètres de ta propriété, puis clique sur Export groupé de données. Renseigne l'identifiant du projet Google Cloud et sélectionne la région du dataset. Cette région doit correspondre exactement à ce que tu as défini à l'étape 1.

Étape 4 : Valider et attendre le premier export

Après validation, Google effectue une exportation de test. Si la configuration est correcte, les exports réels démarrent dans un délai maximal de 48 heures. Une fois actif, un nouvel export est produit chaque nuit automatiquement.

Point de vigilance. La région du dataset ne peut pas être modifiée après la création. Si tu choisis une région incompatible avec tes autres ressources Google Cloud, tu devras supprimer et recréer le dataset. Choisis dès le départ la région la plus proche de tes pipelines de données existants.

Une fois l'export actif, tu disposes d'une source de données illimitée. La question devient alors évidente. Comment l'interroger efficacement ?

Les requêtes SQL fondamentales pour exploiter les données Search Console dans BigQuery

La position moyenne n'est pas une colonne dans les tables Search Console. Ne pas comprendre ce point fausse tous les rapports construits sans correctif.

Voici les requêtes fondamentales pour démarrer. Elles couvrent les cas d'usage les plus fréquents en suivi de positionnement SEO.

Performance par URL et par requête sur 30 jours

SELECT

url,

query,

SUM(impressions) AS impressions,

SUM(clicks) AS clicks,

SAFE_DIVIDE(SUM(clicks), SUM(impressions)) AS ctr,

SAFE_DIVIDE(SUM(sum_position), SUM(impressions)) + 1 AS avg_position

FROM `ton_projet.ton_dataset.searchdata_url_impression`

WHERE search_type = 'WEB'

AND data_date BETWEEN DATE_SUB(CURRENT_DATE(), INTERVAL 30 DAY) AND CURRENT_DATE()

GROUP BY 1, 2

ORDER BY clicks DESC;La fonction SAFE_DIVIDE remplace une division classique pour éviter les erreurs sur les lignes sans impression. Le + 1 après la division corrige l'indexation à zéro de Google. Sans ce correctif, toutes tes positions sont décalées d'un rang vers le bas.

Filtrer par type de recherche

La colonne search_type accepte les valeurs WEB, IMAGE, VIDEO et NEWS. Ne pas filtrer sur cette colonne revient à mélanger des volumes d'impressions incomparables. Une page qui génère 10 000 impressions en recherche image et 200 en recherche web produit une position moyenne sans signification si les deux sont agrégées.

Pour un rapport SEO automatisé connecté à Looker Studio, ces requêtes servent de couche de transformation. Tu les enregistres comme vues BigQuery, puis Looker Studio les interroge directement sans recalcul à chaque actualisation.

La fiabilité de la source est plus importante que la sophistication de la requête. Une bonne requête sur des données tronquées reste une analyse fausse.

Le Protocole BASE : ancrer BigQuery comme source SEO principale

Il ne suffit pas d'activer l'export pour en tirer de la valeur. La plupart des équipes configurent BigQuery, l'oublient pendant deux mois, puis continuent à exporter manuellement depuis l'interface. Voici la méthode structurée pour éviter ça.

Étape 1, Baseline. Avant l'activation, documente l'état actuel. Relève le nombre de requêtes actives dans Search Console, d'URLs visibles et la fenêtre temporelle disponible. Cette base de référence te permet de mesurer ce que BigQuery révèle en supplément.

Étape 2, Activation. Configure l'export groupé selon les quatre étapes décrites plus haut. Vérifie ExportLog 48 heures après l'activation pour confirmer que le premier export s'est exécuté sans erreur.

Étape 3, Schéma. Prends 30 minutes pour explorer les tables dans l'interface BigQuery. Identifie les colonnes disponibles, leurs types, et les valeurs uniques de search_type et de country. Cette exploration évite les requêtes qui produisent des résultats silencieusement incorrects.

Étape 4, Exploitation. Construis a minima une vue BigQuery par cas d'usage récurrent. Une pour la performance par URL, une pour la performance agrégée par propriété, une pour le suivi de position sur les requêtes cibles. Connecte ces vues à ton outil de reporting SEO habituel.

Aidez-moi à appliquer le Protocole BASE sur mon siteCe que BigQuery change dans le workflow SEO au quotidien

Passer à BigQuery comme source principale n'est pas une décision technique. C'est un changement de méthode qui touche la façon dont tu conduis tes audits SEO et tes analyses de performance.

Avec l'interface Search Console, l'historique est limité à 16 mois glissants. BigQuery conserve toutes les données depuis la date d'activation de l'export, sans limite dans le temps. Un site qui active BigQuery aujourd'hui et l'interroge dans trois ans disposera de trois ans d'historique continu. C'est une asymétrie considérable pour les diagnostics post-pénalité ou les suivis de refonte.

Avec BigQuery, tu peux aussi croiser les données Search Console avec d'autres sources via SQL natif. Un JOIN entre ta table searchdata_url_impression et une table de données e-commerce te permet de calculer la valeur générée par position, ou d'identifier les pages les mieux positionnées avec le plus faible taux de conversion. Ce type d'analyse est structurellement impossible dans l'interface native.

Pour les équipes qui utilisent Google Analytics 4 exporté dans BigQuery, la jonction Search Console / GA4 devient triviale. Tu relies les données d'impression et de clic aux données de comportement sur site avec une clé URL commune.

L'export BigQuery ne remplace pas les données de couverture d'index. Les clics, impressions et positions sont exportés. Les pages exclues de l'index, les erreurs de crawl SEO et les avertissements de couverture restent uniquement accessibles depuis l'interface Search Console ou l'API Coverage.

BigQuery ne remplace pas Search Console. Il la libère de ses contraintes natives pour qu'elle devienne réellement exploitable à grande échelle.

Questions fréquentes sur l'export BigQuery Search Console

L'export BigQuery Search Console est-il payant ?

L'export lui-même est gratuit. BigQuery applique des frais sur le stockage et les requêtes au-delà du niveau gratuit. Google offre 10 Go de stockage par mois et 1 To de données requêtées par mois sans facturation. Pour la majorité des sites, ces seuils ne sont pas atteints dans le cadre d'un usage SEO standard.

Combien de temps faut-il pour recevoir les premières données après l'activation ?

Google effectue un export de test immédiatement après validation de la configuration. Les exports réels démarrent dans un délai maximal de 48 heures si la configuration est correcte. Il n'y a pas d'export rétroactif des données antérieures à l'activation.

Peut-on diriger plusieurs propriétés Search Console vers le même projet BigQuery ?

Oui, mais chaque propriété Search Console génère son propre dataset dans BigQuery. Tu peux diriger plusieurs propriétés vers le même projet Google Cloud en créant un dataset distinct par propriété. Les tables gardent la même structure dans chaque dataset.

Les données BigQuery correspondent-elles exactement à celles de l'interface Search Console ?

Les volumes globaux sont cohérents, mais des écarts mineurs peuvent apparaître sur certaines combinaisons de dimensions. Cela s'explique par les mécanismes d'agrégation différents entre l'interface et l'export brut. Les requêtes anonymisées ne sont présentes ni dans l'interface ni dans BigQuery.

Trois actions à retenir et ce que ce cours ne couvre pas encore

Les trois actions concrètes à retenir. Activer l'export groupé dans les paramètres Search Console. Vérifier ExportLog 48 heures après l'activation. Construire une vue BigQuery par cas d'usage récurrent avant de connecter un outil de visualisation.

Ce cours couvre la mise en place et les requêtes de base. Ce qu'il ne traite pas encore porte sur trois points. La détection automatique de cannibalisation de mots-clés via SQL, l'analyse de budget de crawl croisée avec les données de performance, et la construction de segments personnalisés pour identifier les pages en zone de danger de position. Ces sujets requièrent une maîtrise préalable du schéma BigQuery et des jointures entre tables.

Les sites qui centralisent leurs données dans BigQuery prennent des décisions SEO basées sur l'intégralité de leur inventaire, pas sur un échantillon. C'est une différence de méthode qui produit une différence de résultats. Si tu veux aller plus loin sur l'exploitation avancée de tes données Search Console, nous pouvons en parler ensemble pendant 20 min ?