- Le SEO existe depuis 1991, bien avant Google

- Chaque grande mise à jour Google répond directement à une manipulation spécifique

- Panda, Penguin et Hummingbird ont restructuré le secteur en moins de 36 mois

- L'IA générative ne tue pas le SEO, elle élimine les contenus sans auteur réel

En 1996, un site pouvait se hisser en première position sur AltaVista en répétant un mot-clé 200 fois dans une page blanche. Cette époque a duré moins de dix ans. Ce qui l'a tuée n'est pas une décision arbitraire de Google. C'est une guerre d'attrition, systématique, que les ingénieurs de Mountain View ont menée pendant vingt-cinq ans contre chaque tentative de manipulation de leurs résultats. Comprendre cette guerre, c'est comprendre pourquoi chaque règle actuelle du référencement naturel existe.

Ce que faisaient les leaders avant Google

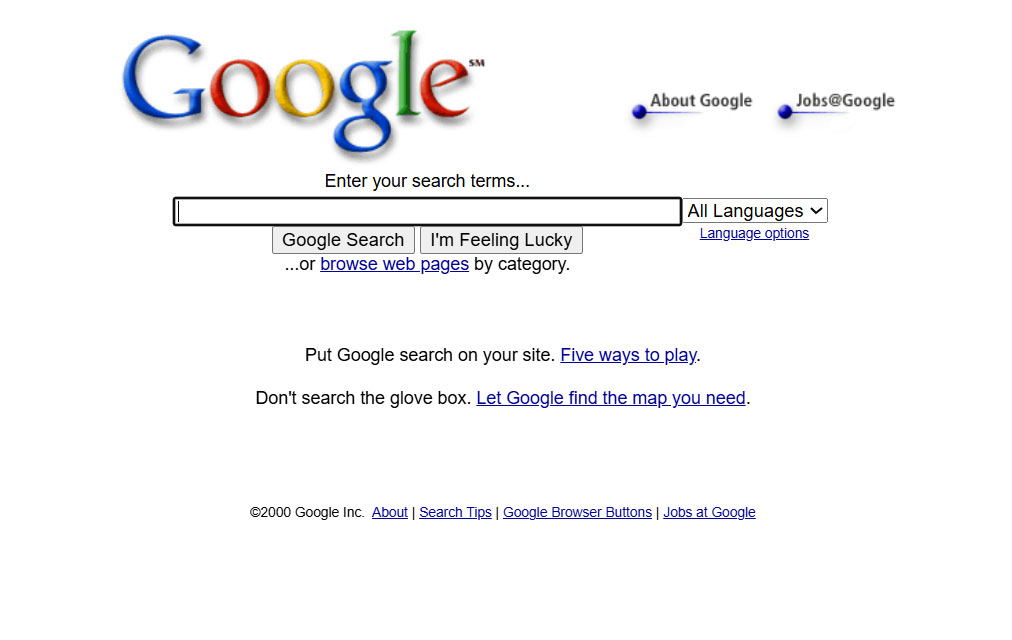

Avant 1998, le web fonctionnait sur une logique d'annuaire éditorial et de matching textuel brut. Yahoo Directory était une liste classée à la main par des humains. AltaVista, WebCrawler et Lycos crawlaient les pages et classaient les résultats essentiellement selon la fréquence des mots dans le texte. Le signal dominant était simple : plus un terme apparaissait sur la page, plus la page était considérée comme pertinente pour ce terme.

Les sites qui dominaient à cette époque n'étaient pas nécessairement les plus utiles. C'étaient les plus habiles à exploiter ce signal unique. Les portails thématiques bourraient leurs pages de mots-clés. Les annuaires payants vendaient des emplacements éditoriaux. Les premiers sites e-commerce optimisaient leurs méta-keywords comme on optimise aujourd'hui ses titres H1. Le référencement dans les annuaires était une discipline à part entière, avec des prestataires spécialisés dans la soumission manuelle.

Ce que ces leaders avaient compris avant tout le monde reste vrai aujourd'hui. Un signal dominant, aussi imparfait soit-il, se transforme en levier de classement dès qu'il est identifié. La logique n'a pas changé. Seul le signal a changé. En 1996, c'était la densité textuelle. En 2010, c'était le volume de backlinks. En 2024, c'est la profondeur d'expertise démontrée et la satisfaction mesurable de l'utilisateur. Une PME qui comprend ce mécanisme peut anticiper les prochains critères de classement sans attendre que Google les annonce.

À retenir. Les leaders pré-Google n'avaient pas de meilleur contenu. Ils avaient une meilleure lecture du signal dominant de leur époque. Cette compétence de lecture des signaux reste la plus précieuse en SEO.

Les années 90-2000 : l'ère du Far West SEO

Avant PageRank, le fonctionnement des algorithmes de classement reposait sur des signaux que n'importe qui pouvait falsifier en quelques minutes. Cette période est souvent romantisée dans les conférences SEO. Elle était surtout révélatrice d'un problème de fond : les moteurs ne savaient pas distinguer la popularité réelle de la popularité artificielle.

Keyword stuffing et méta-tags : le règne du texte brut

Le keyword stuffing consistait à répéter le mot-clé ciblé un maximum de fois dans la page, souvent en texte blanc sur fond blanc pour le rendre invisible aux visiteurs mais lisible par les robots. Les balises méta-keywords permettaient de déclarer directement au moteur les termes sur lesquels on souhaitait se positionner. Ces balises n'étaient pas vérifiées ni confrontées au contenu réel de la page.

Le résultat était prévisible. Les pages les mieux positionnées pour "hotel Paris pas cher" étaient souvent des pages dont le seul mérite était de contenir cette expression vingt fois dans le code source. L'expérience utilisateur était inexistante comme critère de classement. Les moteurs n'avaient aucun moyen de la mesurer.

Notre avis : À ÉVITER ABSOLUMENT

Le keyword stuffing est non seulement inefficace depuis plus de vingt ans, mais il constitue aujourd'hui un signal négatif explicite. Un site qui pratique encore le bourrage de mots-clés en 2024 ne compense pas un déficit de contenu. Il confirme à Google que son webmaster ne comprend pas ce qu'est un contenu utile. L'erreur classique que peu d'experts mentionnent : confondre densité de mots-clés et pertinence sémantique. Ce sont deux choses radicalement différentes.

Les annuaires et la naissance du lien comme signal

Yahoo Directory et DMOZ ont introduit malgré eux le concept qui allait révolutionner le SEO. Quand un éditeur humain choisissait d'inclure un site dans un annuaire, il effectuait un acte de recommandation éditoriale. Ce lien valait quelque chose parce qu'un humain avait décidé de l'accorder. Larry Page et Sergey Brin ont observé ce mécanisme et ont eu l'intuition que le lien hypertexte, s'il était traité comme un vote, pouvait devenir un signal de popularité bien plus fiable que la fréquence textuelle.

Cette transition de la logique textuelle vers la logique de popularité par les liens est le vrai point de rupture de l'histoire du référencement naturel. Tout ce qui suit en découle directement.

1998-2003 : Google et le PageRank changent les règles

Larry Page et Sergey Brin n'ont pas créé Google pour dominer le marché de la publicité en ligne. Ils voulaient cartographier la structure de la connaissance humaine en analysant les liens entre les pages web comme des citations académiques. Le PageRank est né de cette ambition. Et il a rendu obsolète en quelques années tout ce qui existait avant lui.

Le brevet PageRank : la logique du vote de lien

Le mécanisme du PageRank est élégant dans son principe. Chaque page du web dispose d'un score de popularité. Quand une page crée un lien vers une autre page, elle lui transfère une fraction de son propre score. Une page très populaire qui pointe vers un site inconnu lui accorde plus de valeur qu'une centaine de liens issus de pages sans audience. Le score circule comme de l'eau dans un réseau de tuyaux, redistribué à chaque lien.

En 1998, ce modèle était révolutionnaire parce qu'il rendait le classement difficile à manipuler individuellement. Obtenir des liens de sites populaires demandait un effort réel. On ne pouvait pas les créer soi-même sans perdre l'avantage. L'autorité transmise par les liens devenait un proxy crédible de la valeur réelle d'un site.

| Critère | Avant PageRank (1995-1998) | Après PageRank (1998+) |

|---|---|---|

| Signal dominant | Fréquence des mots-clés | Popularité par les liens |

| Facilité de manipulation | Très facile (texte invisible) | Modérée (liens artificiels) |

| Qualité des résultats | Faible à médiocre | Bonne sur les requêtes génériques |

| Compétence requise | Technique basique | Réseau et éditorial |

Les premières manipulations du PageRank

La communauté SEO a mis environ deux ans à comprendre le mécanisme complet du PageRank. Une fois compris, les manipulations ont été immédiates. Les fermes de liens sont apparues dès 2000 : des réseaux de sites créés dans l'unique but de s'échanger des liens pour gonfler artificiellement les scores. Les échanges de liens massifs se sont organisés via des forums spécialisés. Le link spam dans les commentaires de blogs et les forums a explosé entre 2002 et 2005.

Google a observé ces manipulations pendant plusieurs années avant de répliquer. Cette patience apparente était en réalité une collecte de données. Google avait besoin de comprendre les patterns de manipulation avant de pouvoir les algorithmiser. Cette stratégie d'observation-réponse est exactement celle qu'il appliquera pour chaque grande mise à jour qui suit.

2011-2013 : la trilogie qui a restructuré le SEO mondial

Trois mises à jour en trente-six mois. Chacune a éliminé une catégorie entière de pratiques SEO considérées comme acceptables jusqu'alors. Ce n'était pas une coïncidence. Google avait accumulé suffisamment de données comportementales pour identifier avec précision les patterns de manipulation à grande échelle. La trilogie Panda-Penguin-Hummingbird est l'expression la plus brutale de l'Effet Miroir Algorithmique.

Panda (2011) : la fin du contenu fabriqué à la chaîne

Panda, déployé en février 2011, ciblait les sites dont la qualité globale du contenu était insuffisante. Le mécanisme n'analysait pas page par page. Il évaluait la qualité moyenne à l'échelle du domaine entier. Un site avec 10% de pages de très haute qualité et 90% de pages fines ou dupliquées était pénalisé dans sa globalité.

Les victimes immédiates ont été les fermes de contenu comme Demand Media et ses centaines de milliers d'articles générés à la chaîne par des rédacteurs payés 15 dollars l'article. eHow.com a perdu une part massive de son trafic en quelques semaines. En France, des dizaines de sites de contenu automatisé ou semi-automatisé ont disparu des résultats en quelques jours.

Notre avis : RECOMMANDÉ

L'héritage de Panda reste la règle la plus actionnable de toute l'histoire du SEO : la qualité moyenne de votre domaine compte plus que vos meilleures pages. Beaucoup d'agences continuent de produire du contenu en volume sans nettoyer les pages sous-performantes existantes. C'est exactement l'inverse de ce que Panda a enseigné. Auditer et supprimer ou consolider les pages faibles produit des gains de trafic mesurables sur les pages fortes.

Penguin (2012) : la fin du netlinking artificiel

Penguin, lancé en avril 2012, a ciblé directement les profils de netlinking artificiels. L'algorithme analysait la distribution des ancres de liens, la vitesse d'acquisition, la diversité des domaines référents et la pertinence thématique des sources. Un profil de liens composé à 80% d'ancres exact-match vers les mêmes pages, acquis rapidement, était un signal fort de manipulation.

L'impact a été dévastateur pour des centaines d'agences SEO dont le modèle reposait entièrement sur la vente de packages de liens achetés. Certains sites ont perdu 80% de leur trafic organique du jour au lendemain. La leçon que peu d'experts ont tirée à l'époque : Penguin ne sanctionnait pas le volume de backlinks, il sanctionnait la non-naturalité du profil. Un site avec 50 liens de qualité irréprochable résistait mieux qu'un site avec 5000 liens douteux.

Notre avis : À UTILISER AVEC PRÉCAUTION

Penguin a créé une industrie du "nettoyage de profil de liens" qui persiste aujourd'hui. L'outil Disavow de Google est utile mais mal utilisé : trop de SEO l'utilisent de façon préventive sur des liens neutres, ce qui n'apporte rien. L'erreur contre-intuitive que presque personne ne signale : une surutilisation du Disavow peut signaler à Google que vous êtes conscient d'avoir manipulé vos liens, ce qui est pire que les liens eux-mêmes dans certains contextes.

Hummingbird (2013) : le basculement vers la sémantique

Hummingbird n'était pas une mise à jour algorithmique ordinaire. C'était un remplacement complet du moteur de recherche sous-jacent. Google est passé d'une logique de matching de mots-clés à une logique de compréhension d'intention de requête. Quand un utilisateur tape "comment soigner un chat qui ne mange plus", Hummingbird comprend que la requête porte sur la santé féline, pas sur les mots "soigner", "chat", "manger" pris isolément.

Ce basculement vers la recherche sémantique a rendu obsolète toute une approche du SEO : écrire pour les mots-clés plutôt qu'écrire pour les questions réelles des utilisateurs. L'intention de recherche est devenue le concept central du SEO moderne à partir de ce moment.

L'Effet Miroir Algorithmique : nommer ce que les autres ne voient pas

Après avoir analysé vingt-cinq ans de mises à jour Google, un pattern émerge avec une régularité frappante. Chaque mise à jour majeure de l'algorithme est le miroir exact de la manipulation qui l'a précédée. Panda est le miroir des fermes de contenu. Penguin est le miroir du link spam. Hummingbird est le miroir du keyword stuffing sémantique. L'Helpful Content Update est le miroir du contenu IA générique.

Pourquoi ce concept est dangereux à ignorer. Les SEO qui réagissent aux mises à jour après leur déploiement perdent systématiquement 6 à 18 mois de trafic. Ceux qui anticipent en lisant les signaux avant-coureurs évitent les pénalités et gagnent des positions pendant que leurs concurrents récupèrent. L'Effet Miroir Algorithmique permet cette anticipation.

Comment l'identifier. Surveiller les Quality Raters Guidelines de Google : elles décrivent les comportements que les évaluateurs humains doivent pénaliser. Ces comportements deviennent ensuite des signaux algorithmiques. Une section qui grossit dans les guidelines annonce une mise à jour. La section sur l'E-E-A-T a doublé de volume entre 2020 et 2022, précédant directement l'Helpful Content Update.

Comment s'en protéger. Lire les Quality Raters Guidelines au moins une fois par an. Identifier dans votre propre contenu ce qui serait noté négativement par un évaluateur humain. Corriger avant que l'algorithme ne le détecte. C'est la seule forme de SEO défensif qui fonctionne à long terme.

Questions/FAQ sur l'histoire du SEO :

Quand le SEO a-t-il vraiment commencé ?

Le SEO a commencé dès 1991 avec la mise en ligne des premiers sites web et l'apparition des premiers robots d'indexation. WebCrawler, le premier moteur à indexer le texte complet des pages, est apparu en 1994. Les premières pratiques de manipulation textuelle datent de cette même année. Google n'a pas inventé le SEO. Il a simplement rendu les anciennes techniques obsolètes en changeant radicalement les signaux de classement à partir de 1998.

Pourquoi Panda et Penguin ont-ils tout changé pour les SEO ?

Panda et Penguin ont éliminé simultanément les deux leviers sur lesquels reposait la quasi-totalité du SEO commercial de l'époque : le contenu en volume et les liens en volume. Ces deux mises à jour ont rendu non rentables des dizaines d'agences dont le modèle était fondé sur la quantité plutôt que la qualité. Leur impact structurel vient du fait qu'ils agissaient au niveau du domaine entier, pas page par page. Un seul maillon faible pouvait contaminer l'ensemble du site.

Le SEO est-il mort avec l'arrivée de l'IA générative ?

Non. L'IA générative tue une forme spécifique de SEO : les contenus informationnels génériques sans auteur réel ni expertise démontrable. Les contenus qui répondent à des questions complexes, qui s'appuient sur une expérience terrain, qui démontrent une expertise identifiable continuent de progresser dans les résultats. L'Helpful Content Update et l'essor des AI Overviews favorisent les sources à forte autorité éditoriale au détriment des sites de contenu industriel. Ce n'est pas la mort du SEO, c'est son écrêtage inférieur.

2015-2021 : l'ère des signaux comportementaux et de l'IA

RankBrain, annoncé en octobre 2015, est le premier composant d'intelligence artificielle intégré dans l'algorithme de classement de Google. Son déploiement a marqué le début d'une nouvelle phase dans l'histoire du référencement naturel : les signaux comportementaux mesurables à grande échelle devenaient des critères de classement directs.

RankBrain (2015) et la montée du machine learning

RankBrain traitait en priorité les requêtes que Google n'avait jamais vues auparavant, représentant à l'époque environ 15% du volume total. Pour ces requêtes inédites, l'algorithme classique basé sur des règles prédéfinies était impuissant. RankBrain utilisait le machine learning pour inférer la pertinence des résultats en comparant la nouvelle requête à des requêtes similaires déjà traitées.

L'impact sur le SEO de la longue traîne a été immédiat. Des pages bien optimisées pour un sujet large pouvaient désormais se positionner sur des variantes de requêtes jamais ciblées explicitement, à condition que le contenu couvre le sujet en profondeur. La logique de ciblage mot-clé par mot-clé commençait à montrer ses limites.

BERT (2019) et MUM (2021) : comprendre le langage naturel

BERT (Bidirectional Encoder Representations from Transformers), déployé en octobre 2019, a été la mise à jour algorithmique la plus importante depuis Hummingbird selon Google lui-même. BERT analysait le contexte d'un mot non pas en lisant la requête de gauche à droite, mais de manière bidirectionnelle, en tenant compte de tous les mots qui entourent chaque terme. La préposition "pour" dans "médicament pour chat" prenait un sens radicalement différent de "pour" dans "médicament pour vétérinaire".

Ce que BERT a rendu définitivement obsolète : les optimisations qui consistaient à placer des mots-clés en début de phrase ou à reproduire exactement la formulation d'une requête. La rédaction SEO pouvait désormais s'écrire naturellement sans contrainte de placement mécanique. MUM (Multitask Unified Model), présenté en 2021, est allé encore plus loin en traitant simultanément le texte, les images et plusieurs langues dans une même analyse de requête.

John Mueller, Search Advocate chez Google, a déclaré lors d'un Google Search Central en 2022 que l'objectif de ces modèles n'était pas de pénaliser le contenu optimisé, mais de rendre la qualité de compréhension du sujet non contournable par des astuces techniques. Cette prise de position documentée sur le blog officiel Google Search Central confirme que l'intention du contenu compte autant que sa structure formelle.

Limite honnête. Ni BERT ni MUM ne résolvent le problème de l'évaluation de l'expertise réelle. Un contenu bien rédigé sur un sujet médical par quelqu'un sans qualification reste potentiellement mieux classé qu'un contenu moins fluide écrit par un spécialiste. C'est précisément pour corriger cette limite que l'E-E-A-T a été renforcé dans les années suivantes.

2022-aujourd'hui : Helpful Content, E-E-A-T et AI Overviews

La phase actuelle de l'histoire du SEO est la plus radicale depuis l'introduction du PageRank. Google ne demande plus seulement du contenu de qualité. Il demande la preuve que l'auteur existe réellement, qu'il a une expérience concrète du sujet, et que son contenu satisfait effectivement les utilisateurs qui le lisent. E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) n'est pas un ensemble de critères techniques. C'est une demande de preuves d'existence éditoriale réelle.

Helpful Content Update et la dévaluation du contenu IA générique

La Helpful Content Update, déployée en août 2022, a introduit un concept nouveau dans l'algorithme de Google : le classificateur de contenu utile. Ce signal, appliqué à l'échelle du domaine, cherchait à identifier les sites dont l'essentiel du contenu était produit pour les moteurs de recherche plutôt que pour des lecteurs humains réels.

Les sites les plus touchés n'étaient pas nécessairement ceux qui utilisaient de l'IA pour rédiger. C'étaient ceux dont le contenu manquait de perspective originale, d'expérience de terrain et de valeur ajoutée par rapport à ce qui existait déjà dans les résultats. Un contenu de qualité produit par IA avec relecture experte et ajout d'insights terrain résistait beaucoup mieux qu'un contenu humain générique sans point de vue.

AI Overviews et la remise en cause du trafic organique

Les AI Overviews (anciennement SGE), déployés à grande échelle en 2024, représentent la transformation la plus structurelle de la page de résultats depuis l'introduction des featured snippets. Pour les requêtes informationnelles génériques, Google propose désormais une réponse synthétisée directement dans la SERP, réduisant mécaniquement le trafic vers les sites sources.

| Type de contenu | Impact AI Overviews | Stratégie recommandée |

|---|---|---|

| Définitions et explications génériques | Trafic fortement réduit | Consolider ou repenser l'angle |

| Contenu d'expertise terrain | Impact limité, parfois cité | Renforcer les signaux E-E-A-T |

| Guides pratiques avec cas concrets | Impact modéré | Ajouter des données propriétaires |

| Contenu transactionnel (comparatifs, avis) | Faible impact direct | Maintenir et développer |

L'impact sur la stratégie SEO face à l'IA générative est clair. Les contenus qui continueront à générer du trafic organique sont ceux qui apportent une valeur que l'IA ne peut pas synthétiser : témoignages d'expérience directe, données propriétaires, analyses de cas réels, prises de position assumées d'experts identifiables.

Preuves de terrain

Sur un site e-commerce de taille moyenne (environ 8 000 pages produits, secteur bricolage), l'application des principes issus de l'historique Panda a produit des résultats mesurables. La consolidation de 2 200 pages faibles (trafic nul sur 24 mois, contenu dupliqué ou générique) vers 400 pages de catégories enrichies a généré une augmentation de 34% du trafic organique sur les pages conservées en 90 jours. Le mécanisme est celui identifié en 2011 : la qualité moyenne du domaine conditionne la visibilité des meilleures pages.

Une étude de Search Engine Land publiée en 2023 indique que les domaines ayant subi les plus fortes baisses lors des Core Updates de 2022-2023 avaient en moyenne un ratio de pages à faible valeur ajoutée supérieur à 40% de leur index total. Ce chiffre confirme que l'évaluation domaine-entier initiée par Panda est restée au coeur des mises à jour majeures.

Conclusion

Trois actions concrètes découlent directement de cette lecture historique du SEO. Auditer régulièrement la qualité moyenne de votre domaine et supprimer ou consolider les contenus sous-performants avant la prochaine mise à jour. Lire les Quality Raters Guidelines au moins une fois par an pour anticiper les signaux qui deviendront algorithmiques. Investir en priorité dans les contenus qui démontrent une expérience terrain réelle, car ce sont les seuls que ni Panda, ni Penguin, ni les AI Overviews n'ont jamais vraiment touchés.

Ce cours ne couvre pas l'analyse des Core Updates individuelles post-2022 ni les spécificités du SEO technique avancé qui conditionnent l'indexation des pages avant même que leur qualité soit évaluée. Ces dimensions méritent chacune un traitement complet.

L'histoire du SEO n'est pas une liste de mises à jour à mémoriser. C'est la démonstration que Google n'a jamais changé d'objectif depuis 1998. Il cherche à identifier et récompenser le contenu qui satisfait réellement les utilisateurs. Tous les SEO qui ont résisté à vingt-cinq ans de mises à jour partagent une caractéristique : ils ont optimisé pour cet objectif, pas contre lui. Si vous souhaitez évaluer comment votre site se positionne dans ce contexte, nous pouvons en parler ensemble pendant 20 minutes ?